Rada Modeli: Jak eliminujemy halucynacje AI

Za kulisami wieloagentowego pipeline'u Taufolio, który używa kilku wiodących modeli do weryfikacji faktów, zanim trafią one do Twojego raportu.

Team

Kiedy zadajesz pytanie o spółkę giełdową zwykłemu chatbotowi AI, otrzymujesz jedną odpowiedź od jednego modelu. Jeśli ten model zhalucynuje (zmyśli) marżę zysku, nie masz o tym pojęcia, dopóki sam ręcznie nie sprawdzisz oryginalnych dokumentów.

W świecie inwestowania zmyślona liczba to nie "urok technologii" — to gigantyczne ryzyko finansowe.

Właśnie dlatego Taufolio nie polega na pojedynczym modelu sztucznej inteligencji. Zbudowaliśmy Radę Modeli (Model Council, znaną też jako Model Quorum) — wieloetapowy, wieloagentowy potok (pipeline) zaprojektowany specjalnie po to, by minimalizować halucynacje i maksymalizować dokładność.

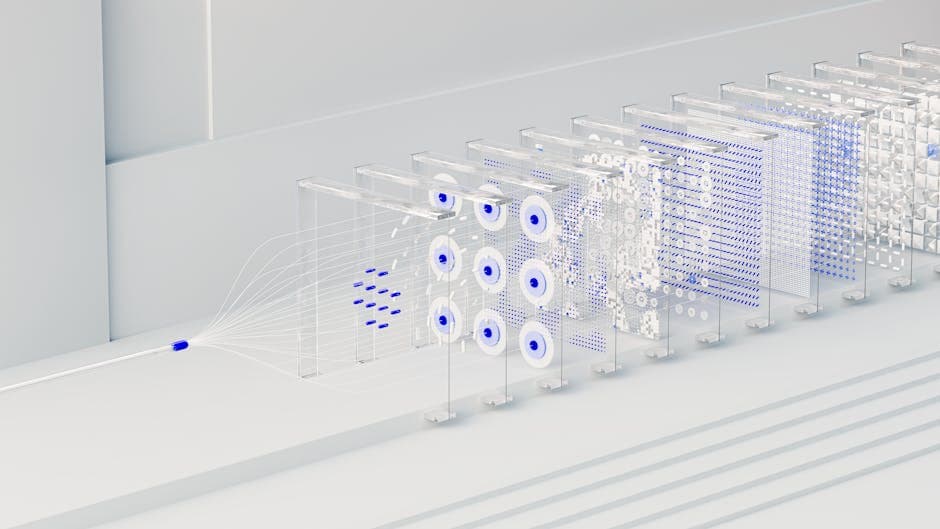

Architektura: Wieloagentowy Pipeline

Aby zbudować platformę badawczą profesjonalnej klasy, musieliśmy wyjść poza paradygmat "jeden prompt, jedna odpowiedź". Nasze raporty z serii Pełna analiza (Deep Research) wykorzystują skomplikowany system oparty na wielu API, weryfikacji wiadomości ze świata zewnętrznego i kilku wyspecjalizowanych agentach AI pracujących razem.

Choć nasze dokładne prompty (instrukcje) pozostają tajemnicą technologiczną firmy, oto wysokopoziomowy przegląd tego, jak działa ten mechanizm:

1. Agenci Zbierający Dane

Zanim rozpocznie się jakakolwiek analiza, wyspecjalizowani agenci pobierają źródła pierwotne. Pobierają najnowsze raporty 10-K i 10-Q z bazy danych SEC EDGAR, wyciągają transkrypcje z konferencji wynikowych i łączą się z wieloma zewnętrznymi interfejsami API, aby pobrać wysokiej jakości, zweryfikowane wiadomości rynkowe (np. z Bloomberga). To zapewnia, że AI jest ograniczone do twardej rzeczywistości, zamiast polegać na swojej "pamięci" z okresu trenowania.

2. Wyspecjalizowani Analitycy (Rada)

Gdy dane są już zebrane, nie trafiają tylko do jednego modelu. Używamy podejścia wielomodelowego. Trzech oddzielnych, niezależnych "Agentów-Analityków" — często zasilanych przez różne wiodące modele od najlepszych dostawców — otrzymuje dokładnie ten sam zestaw dokumentów i to samo zadanie badawcze (np. "Przeanalizuj fosę konkurencyjną firmy").

Ponieważ modele te mają inną architekturę i inne wagi treningowe, zauważają różne rzeczy.

3. Agent Koordynator

Tu dzieje się cała magia. Trzy niezależne analizy trafiają do ostatecznego Agenta Koordynatora. Koordynator działa jak surowy Dyrektor Zarządzający w banku inwestycyjnym. Jego zadaniem jest porównanie odpowiedzi.

- Zgoda: Jeśli Agent A i Agent B zgadzają się, że marże spadły z powodu problemów z łańcuchem dostaw, i obaj cytują ten sam akapit w 10-K, twierdzenie to jest weryfikowane i dołączane do Twojego raportu.

- Rozbieżność: Jeśli Agent A twierdzi, że marże spadły o 5%, ale Agent B twierdzi, że o 2%, Koordynator oflaguje tę rozbieżność, ponownie sprawdzi tekst źródłowy, a jeśli nie da się tego ostatecznie udowodnić, twierdzenie zostaje odrzucone.

Dlaczego używamy wielu zewnętrznych API do wiadomości

Nie chcemy, aby sztuczna inteligencja próbowała "przypomnieć sobie", co stało się z firmą w zeszłym miesiącu. Pamięć tworzy halucynacje. Podłączając Radę Modeli bezpośrednio do interfejsów API z danymi finansowymi i kanałów wiadomości premium, zmuszamy AI do czytania bieżącego tekstu, a nie do zgadywania.

Efekt? Otrzymujesz raport, który opiera się na faktach, jest sprawdzony przez wielu "analityków" i całkowicie weryfikowalny dzięki przypisom (cytatom ze źródeł).